Etik och säkerhet när AI möter IoT

Bilder från forskare och näringslivet om säkerhet och etik när

artificiell intelligens integreras med Internet of Things

Ethics and security when AI meets IoT

Images from scientists and enterprises on security and ethics

when integrating artificial intelligence with the Internet of

Things

Kandidatuppsats

Axel Kimblad

Bojan Radosavljevic

Huvudområde: Informatik

Examensarbete: Kandidatnivå

Antal högskolepoäng: 13hp

Termin: VT 2019

Sammanfattning

I dagens samhälle går den tekniska utvecklingen fort framåt. Artificiell intelligens och Internet of Things är två tekniker inom utvecklingen vars popularitet har ökat på senare tid. Dessa tekniker i integration har visat sig kunna bidra med stora verksamhetsnyttor, bland annat i form av ökad precishet vad gäller analyser, bättre kundvärde och effektivisering av ”downtime”. Med ny teknik kommer även utmaningar. I takt med att teknologierna ständigt växer uppstår frågor kring säkerhet och etik och hur detta ska hanteras.

Målet med denna studien var att ta reda på hur experter värderar etiska frågor när artificiell intelligens används i kombination med Internet of Things-enheter. Vi fokuserade på följande forskningsfråga för att nå vårt mål: Hur värderas frågor om etik när artificiell intelligens används i kombination med Internet of Things?

Resultatet vi kom fram till visar att både forskare och näringslivet värderar de etiska aspekterna högt. Studien visar även att de ansåg att teknikerna kan vara lösningen till många samhällsproblem men att etiken bör vara ett ämne som löpande bör diskuteras.

Nyckelord: Artificiell intelligens, Internet of Things, Maskininlärning, Säkerhetsaspekter, Etisk användning, Värdeskapande

Abstract

In today's society, technological developments are moving fast. Artificial intelligence and the Internet of Things are two technologies within the development whose popularity has increased in recent years. These technologies in integration have proven to be able to contribute with major business benefits, including in the form of increased precision with regard to analyzes, better customer value and efficiency of downtime. New technology also presents challenges. As the technologies are constantly growing, issues arise regarding safety and ethics and how this should be managed.

The aim of this study is to find out how experts value ethical issues when using artificial intelligence in combination with the Internet of Things devices. We focused on the following research question to reach our goal: How are ethical issues evaluated when using artificial intelligence in combination with the Internet of Things?

The result we found shows that both researchers and the business world value the ethical aspects highly. The study also shows that they considered the techniques to be the solution to many societal problems, but that ethics should be a topic that should be discussed on an ongoing basis.

Key words: Artificial intelligence, Internet of Things, Machine learning, Security, Ethical use, Value-creation

Innehåll

1 Inledning ...1

1.1 Bakgrund ...1

1.2 Problemformulering ...2

1.3 Syfte och frågeställning ...2

1.4 Avgränsning och Målgrupp ...3

2 Teori ...3

2.1 Artificiell Intelligens ...3

2.1.1 Maskininlärning ...4

2.2 Algoritm ...6

2.3 Internet of Things ...7

2.4 EU:s etiska ramverk ...8

2.5 Etik ... 10 3 Forskningsmetodik ... 10 3.1 Vetenskaplig ansats ... 10 3.2 Datainsamling ... 11 3.2.1 Sekundärdata ... 11 3.2.2 Semistrukturerade intervjuer ... 11 3.3 Genomförande ... 11 3.4 Urvalsdiskussion ... 11 4 Dataanalys ... 12 5 Resultat ... 13 5.1 Litteraturstudie... 13 5.1.1 Etik i AI behövs ... 14

5.1.2 Möjligheter är stora med AI och IoT ... 15

5.1.3 Utmaningar är stora med AI och IoT ... 15

5.2 Intervju ... 16

5.2.1 Ett perspektiv från en expert inom Innovation Skåne. ... 16

5.2.2 Ett perspektiv från en expert inom Tieto. ... 17

6 Analys ... 18

6.1 EU:s etiska ramverk ... 20

6.1.1 Mänsklig kontroll och översikt ... 21

6.1.2 Teknisk robusthet och säkerhet... 21

6.1.3 Integritet och Data Governance... 22

6.1.4 Transparens... 22

6.1.5 Diversitet, icke diskriminerande och rättvisa ... 22

6.1.7 Ansvarighet ... 23

6.2 Etiska teorier ... 23

7 Slutsats ... 24

8 Vidare forskning ... 25

1

1 Inledning

1.1 Bakgrund

Artificiell intelligens (AI) har på senare år blivit mer och mer erkänt som vetenskap och som teknologi. Stora teknikföretag såsom Google, Facebook och Apple är i full gång med att utnyttja möjligheterna som tekniken ger (Arpteg, A., Brinne, B., Crnovic-Friis, L. & Bosch, J., 2018), bland annat genom optimering av sökmotorernas algoritmer som presenterar relevanta sökresultat för användaren (Yuniarthe, 2017). För Sveriges del betonar Regeringskansliet (u.d.) att det övergripande målet för Sveriges digitaliseringspolitik är att Sverige ska vara bäst i världen på att utnyttja digitaliseringens möjligheter. Med artificiell intelligens vill Sverige ta tillvara på möjligheterna som tekniken kan ge, med syfte att stärka både den svenska välfärden och den svenska konkurrenskraften. Idag tillämpas tekniken inom flera olika områden, bland annat som beslutsstöd inom sjuk- och hälsovården samt som adaptiva program inom utbildningsområdet (Sveriges Kommuner och Landsting, 2018). Nilsson (1998) definierar artificiell intelligens som intelligent uppförande i artefakter, och menar på att intelligent uppförande involverar resonemang, lärande, kommunikation och agerande i komplexa miljöer. Med artificiell intelligens finns även risker. Regeringskansliet (u.d.) anser att nya typer av intelligenta cyberattacker, manipulerad data samt att AI kan sänka trösklarna för angrepp mot demokratiska funktionssätt är en del av de risker som tekniken kan medföra. De anser även att riskerna inte enbart är tekniska utan även etiska där de menar att riskerna bland annat berör applikationer i offentlig verksamhet där användningen av AI måste vara mer transparent och förståelig.

Internet of Things

Samtidigt som användandet av den artificiella intelligensen har expanderat har en annan teknik vuxit och blivit mer populär. Tekniken kallas Internet of Things (IoT), sakernas internet på svenska, och definieras av Singh & Singh (2015) som ett nätverk av enheter där enheterna kommunicerar med varandra utan människans inblandning. IoT ekosystemet består bland annat av smarta objekt och intelligenta enheter. Enligt Bouhai (2017) refererar dessa smarta objekt och intelligenta enheter till ett nytt sätt att leva och ett nytt sätt att hantera affärer via internet. Resonemanget får medhåll från författaren Greengard (2015) som menar att Internet of things kommer innebära den andra vågen av digital revolution, där allting kommer att påverkas, från sättet vi äter på restauranger till sättet vi röstar och tar semester på.

Enligt Sveriges Kommuner och Landsting (2018) kopplas fem miljoner nya saker upp mot internet dagligen och är en central del av digitaliseringen av samhället. Vidare menar Sveriges Kommuner och Landsting (2018) att fördelen med IoT bland annat är att ny kunskap och nya insikter kan skapas eftersom alla uppkopplade saker genererar information som sammantaget blir till mycket stora mängder data. Med hjälp av artificiell intelligens kan dessa mängder av data analyseras på långt mer avancerade och komplexa sätt än vad som tidigare varit möjligt. Organisationer kan dra nytta av uppkopplade enheter genom att enheterna bidrar med stora affärsmöjligheter, bland annat i form av ökad produktivitet och bättre kostnadsbesparingar (Goldman Sachs, 2014). Framför allt menar Goldman Sachs (2014) att IoT kommer påverka tre aspekter inom industrin: (1) Automatisering, (2) Tillverkning och (3) Resurser. Internet of Things är en stor del av digitaliseringen. Dock påpekar Sveriges Kommuner och Landsting (2018) att som med all ny teknik finns det risker som ej går att förbise. Uppkopplade enheter som ej har ett tillräckligt skydd kan lätt bli hackat och styras av obehöriga.

Artificiell intelligens integrerat med Internet of Things

Den stora mängden data som genereras av uppkopplade enheter leder till en ökad efterfråga av nya analysmodeller. Enligt Ahamed & Farid (2018) används maskininlärning som verktyg inom sjuk- och hälsovården för att utveckla nya analytiska modeller. Modellerna analyserar den insamlade datan från olika beslutsstödsystem och sjukvårdsutrustning för att upptäcka beteendemönster och patienters kliniska tillstånd. Detta i sin tur leder till ett mer konkret beslutsstöd för doktorerna. Maskininlärning integrerat med Internet of Things-enheter erbjuder ett nytt underlag för analyser av data. Genom denna

2

integration visar Reddy, Mamatha och Reddy (2018) att organisationer kan utnyttja datan till sin fördel och därigenom skapa nya affärsmöjligheter.

Maskininlärning i kombination med Internet of Things kommer att förändra sättet vi ser på vår omgivning. Den virtuella miljön har alltmer förenats med den fysiska. I rapporten Implementation Strategy Industrie 4.0 framtagen av Bitkom, VDMA & ZVEI (2016), understryks det att ny teknik och nya sätt att arbeta kommer leda till att verksamheter måste ställa om tillverkning för att fortsätta vara konkurrenskraftiga och bibehålla kunder. Vidare betonar rapporten att ny teknik kommer att ha en inverkan på existerande affärsmodeller och processer. Bitkom, VDMA & ZVEI (2016) menar att detta således innebär att verksamheters interna miljö kommer att stå inför stora förändringar vid implementering av den nya tekniken.

Vårt intresse ligger i att undersöka hur experter som jobbar med teknikerna och forskare ser på risker och etiska utmaningar när AI används i kombination med IoT-enheter. Eftersom etik är subjektivt och ser annorlunda ut beroende på vem som tillfrågas vill vi även se hur experter och forskare förhåller sig till olika etiska teorier.

1.2 Problemformulering

Genom att använda artificiell intelligens med Internet of Things menar Nathani & Vijayvergia (2017) att Internet of Things-enheter kan lära sig att förstå sin omgivning och agera utifrån sin lärdom. I media rapporteras det att företag bör vara försiktiga med dessa tekniker. Bland annat nämner rådgivaren till den svenska digitaliseringsministern, Anna Felländer, i NyTeknik (2018) att det finns flera etiska oavsiktliga negativa konsekvenser med AI såsom missbruk av data (olika öppen data kombineras och skapar intelligens som är integritetskränkande för individen), otränad AI (applikationer med ansiktsigenkänning har visat sig misslyckas med att läsa av mörkhyade kvinnor eftersom den tränats för lite på dessa ansikten) och data bias (när datan som algoritmen tränas på inte reflekterar verkligheten eller den önskade verkligheten).

Telekomidag (2017) framställer en rapport, gjord av satellitkommunikationsbolaget Inmarsat, som visar att endast tre av tio energibolag har tagit särskild hänsyn till hur de ska skydda Internet of Thingsfunktionerna redan vid installation. Där menar Telekomidag (2017) att undersökningen pekar på att närmare 60 procent av bolagens ledning saknar kunskaper inom IoT eller har mycket bristfälliga kunskaper.

Anna Felländer argumenterar i en annan artikel, skriven av Niklas Fagerström, från yle (2018) att i och med att AI-system fungerar och lär sig på basis av hur de programmeras så kan algoritmer utan etik ge artificiell intelligens utan moral. Som exempel ger Felländer i artikeln att en AI prioriterar vita människor framför mörkhyade eftersom den ej har tränats tillräckligt. Vidare anser hon att AI-system borde köras genom etiska filter och etiska kontrollsystem. I takt med den snabba utvecklingen av artificiell intelligens ökar även behovet av ett etiskt tankesätt kring utvecklingen. Digitaliseringsexperten får medhåll från AI-forskaren Virginia Dignum (2018) där forskaren menar att för att undvika en dystopisk framtid där obehörigas möjligheter ökar med att tillfoga skada med digitala system och robotar, måste dessa system introduceras på ett sätt som bygger tillit, förståelse och respekterar mänskliga rättigheter.

1.3 Syfte och frågeställning

Studien syftar till att bidra med ökad förståelse kring säkerhetsaspekterna med betoning på etiska aspekter när artificiell intelligens används i Internet of Things-enheter. I studien har vi även belyst olika möjligheter och utmaningar med integrationen. För att nå syftet har vi intervjuat två personer som

3

besitter expertis kring teknologierna. Genom intervjuerna kunde vi fånga upp informanternas tankar och attityder kring ämnet i fråga.

Utifrån ovanstående tema och syfte har studien fokuserat på följande forskningsfråga:

• Hur värderas frågor om etik när artificiell intelligens används i kombination med Internet of Things?

Under arbetets gång har vi arbetat med följande arbetsfrågor:

• Hur ser forskare på etiska aspekter när AI används med IoT?

• Hur ser experter inom näringslivet på etiska aspekter när AI används med IoT? • Hur ser forskare på möjligheter och utmaningar som uppstår ur integrationen?

• Hur ser experter inom näringslivet på möjligheter och utmaningar som uppstår ur integrationen?

1.4 Avgränsning och Målgrupp

Artificiell intelligens och Internet of Things är två väldigt omfattande ämnen och på grund av tidsramen för vår studie kommer fokus ej läggas på alla de tekniker som ryms inom paraplybegreppen. Därför valde vi att belysa maskininlärning, och smarta sensorer vars uppgift är att samla in data då dessa utformar en stor del av de båda tekniska fälten. Studien har fokuserat på användandet av maskininlärning som analysenhet i Internet of Things-sensorer samt säkerhetsaspekter kring det. Eftersom vi valt att undersöka hur forskare och de som jobbar med teknikerna uppfattar tekniken, avgränsar vi oss mot de tekniska specifikationerna och väljer att ej fördjupa oss inom detta. Forskarnas värderingar har vi undersökt genom sekundärdatan i betydelsen hur de beskrev och framställde etiska utmaningar. Studien riktar sig till företag som står i ett vägval i att anamma dessa tekniker i kombination. Studien kan även användas som ett komplement för verksamheters riskanalyser för att bättre rusta sig inför potentiella framtida osäkerheter. Vidare kan forskningssamhället ta del av resultatet från studien och använda det som ett tillägg i form av etiska- och säkerhetsdiskurser till deras egen forskning.

2 Teori

2.1 Artificiell Intelligens

Hur ska artificiell intelligens definieras? De första stegen mot artificiell intelligens togs för länge sedan av Aristoteles (384-322 B.C) när han försökte förklara och kodifiera vissa typer av ett deduktivt resonerande (Nilsson, 1998). Ett försök i att komma fram till svaret på frågan om vad artificiell intelligens innebär gjordes av fadern inom artificiell intelligens, Alan Turing, på 1950-talet. Han skapade ett test för att testa maskinens intelligens kontra mänsklig intelligens. Testet gick ut på att en testperson skulle avgöra ifall en fördefinierad fråga hade besvarats av en människa eller dator. Testpersonen ställde frågan i ett nätverk där antingen en maskin eller människa skulle besvara frågan. Ifall testpersonen ej kunde avgöra om svaret kom från maskinen eller människan blev slutsatsen att maskinen uppvisade intelligens, en artificiell intelligens (Jones, 2015).

Många mänskliga aktiviteter såsom att räkna matematik, förstå språk, programmera mjukvara och köra bil kräver en viss typ av intelligens. På senare tid har datorsystem utvecklats som kan utföra dessa aktiviteter. Idag finns det datorsystem som kan diagnostisera sjukdomar och känna igen tal (Nilsson, 2014). Kulkarni & Joshi (2015) påpekar att artificiell intelligens håller på att bli en del av människans vardag och ingår som en essentiell del av modern utrustning. Författarna menar även att de artificiellt

4

intelligenta systemen förbättrar noggrannheten och utför uppgifter som ej hade varit möjligt för människan.

Artificiell intelligens är ett begrepp som innefattar flera olika maskinella lösningar som skapas för att försöka efterlikna mänskligt beteende, beslutsfattande eller något som vanligtvis kräver en mänsklig hjärna för att slutföra. Enligt Gosh, Chakraborty, & Law (2018) används artificiell intelligens idag inom flera olika akademiska områden som exempelvis filosofi, matematik, statistik, biologi och psykologi för att nämna några. Inom dessa områden finns det fall där det behöver analyseras stora mängder data. Detta kan göras av en människa men kommer ta väldigt lång tid. Istället kan en AI användas för att analysera datan och presentera ett hanterbart resultat. Gosh et al. (2018) beskriver också att AI kan ses som en teknik som analyserar data på ett effektivt sätt så att den blir förståelig, modifierbar, användbar i det givna scenariot och meningsfull. Utifrån detta ramverk finns det ett flertal tekniska lösningar som kan samlas under begreppet AI. Ett exempel på en teknik som inkorporerar flera av dessa tekniker är röst-assistenter som exempelvis Amazons “Alexa” eller Googles “Google Home”. En röst-assistent är en molnbaserad rösttjänst som kan utföra uppgifter som exempelvis ringa samtal, boka restauranger, spela musik och styra smarta lampor i hemmet genom användarens röst input. För att kunna utföra dessa uppgifter krävs flera olika former av AI. Röst assistenter använder sig av bland annat automatisk röstigenkänning, röst till text konvertering, kontextuellt resonerande, besvarande av frågor, och dialoghantering (Gosh et al., 2018).

2.1.1 Maskininlärning

“The process by which a computer is able to improve its own performance (as in analyzing image files) by continuously incorporating new data into an existing statistical model”

• Meriam Webster Dictionary, since 1828

Artificiell intelligens är ett paraplybegrepp som innefattas av flera olika discipliner, bland annat maskininlärning (ML). Maskinens lärande ska bidra till automatisk kunskapsförvärv och för att detta ska kunna ske måste måste det finnas en tidigare kunskap som maskininlärningsmodellen kan lära sig av (Callan, 2003). Författaren menar att det automatiska kunskapsförvärvet ska leda till att modellen tränas och förbättras för att uppnå ett bättre resultat. Gosh et al. (2018) menar att ML kan anses vara en av de starkast bidragande faktorerna till stora framsteg inom AI. I artikeln “Software Engineering Challenges of Deep Learning” som är skriven av Arpteg et al. (2018) beskrivs det att en av de framstående skillnaderna mellan system och icke system är att data delvis ersätter kod i ML-system. Exempelvis när en inlärnings algoritm används för att automatiskt identifiera mönster i datan istället för att skriva hårdkodade regler (ibid).

Inom maskininlärningsbegreppet finns ytterligare tekniker såsom bland annat neural networks och deep learning. Neural network är en teknik vars uppgift är att simulera lärandet i biologiska organismer som är uppbyggt av neuroner, datorn ska lära sig från observerad data (Aggarwal, 2018). Deep learning innebär att algoritmerna jobbar genom gömda datalager för att hitta olika mönster (Bhardwaj, Di & Wei, 2018). Deep learning används vanligen inom neural networks. Bildigenkännings- och röstigenkänningsprogram är vanliga exempel där deep learning appliceras.

Mohri, Roztamizadeh & Talwalkar (2014) menar att det går att klassificera maskininlärningsmodeller efter vilka metoder de använder. Två populära kategorier är övervakad inlärning (supervised learning) och oövervakad inlärning (unsupervised learning). Enligt Saravanan & Sujatha (2018) är den övervakade inlärningen en enklare variant som innebär att algoritmerna använder det de har skaffat sig kunskap om och tränas för att kunna förutspå framtida händelser. Tekniken bygger på att algoritmer använder en känd träningsdata som består av in- och utdata. Oövervakad inlärning skiljer sig från övervakad inlärning på så sätt att den innehåller data men ingen lösning. Datorn måste på egen hand komma fram till en lösning (Louridas & Ebert, 2016). Nedan följer en beskrivning av algoritmer som ingår i övervakad inlärning och oövervakad inlärning.

5

Övervakad inlärning

• Klassificeringsalgoritmer

Algoritmen tar träningsdata som input och en klass av varje data så att datorn kan lära sig att klassificera den nya datan. Ett exempel på input är tidigare låneansökningar med en indikation på vilket av lånen som gick fel. Med det som bas klassificerar datorn nya låneansökningar (Louridas & Ebert, 2016).

• Regressionsalgoritmer

Data används för att förutse, så nära det går, det korrekta värdet på saken som ska undersökas. Ett exempel på regression är att prognostisera kontinuerliga data, såsom att förutsäga trenden för en aktiekurs med tanke på sina tidigare priser(Mohri, et al., 2014).

Oövervakad inlärning

• Klustringsalgoritmer

Algoritmerna delar in datan i likartade regioner. Klustring används ofta när avsikten är att analysera stora mängder data. Exempel på klustring är när sociala nätverk ska analyseras, då används algoritmen för att identifiera mindre grupper inom stora grupper människor (Mohri, et al., 2014).

• Dimensionell reduktion

Transformerar en initial representation av datan till en lägre dimensionell representation medan den behåller några egenskaper från den ursprungliga representationen. Ett exempel är förprocessering av digitala bilder (Mohri, et al., 2014).

6

Figur 1. En bild av kategorierna supervised learning och unsupervised learning samt deras respektive algoritmer och klasser (Louridas & Ebert, 2016).

Det finns tusentals olika algoritmer inom maskininlärningskonceptet och hundratals nya publiceras varje år. Dock visar Domingos (2012) att alla algoritmer består av en kombination av endast tre komponenter (1) Representation, (2) Evaluering och (3) Optimering. Representation innebär att definiera vad problemet är, ett klassificerings-, regressions- eller klustringsproblem. Det görs via ett formellt språk som datorn kan tolka. När problemet väl definierats tillämpas lämplig algoritm, exempelvis random forests eller logic regression. Evaluering handlar om att, med hjälp av särskilda poängsättningsfunktioner, särskilja bra modeller från dåliga modeller. Den sista komponenten, optimering, handlar om att använda en metod som söker igenom modellerna och därigenom hitta den modell som fått högsta poäng från evalueringen.

2.2 Algoritm

Ordet algoritm härstammar från den arabiska matematikern, Muhammad ibn Musa al-Khwarizmi, som levde mellan 700- och 800 talet. En algoritm är en samling instruktioner som ska följas för att lösa ett specifikt problem, vanligtvis inom matematik, men behöver inte enbart handla om matematik (Devlin, 1994). Vanliga matrecept är exempel på algoritmer. Ett annat exempel på algoritm är, enligt Devlin (1994), instruktioner på hur man byter ett däck på en bil. För det krävs att specifika steg följs som ska leda fram till att däcken sitter på bilen. Enligt Currie (2006) bör en algoritm åtminstone vara:

• Komplett: Det ska inte vara möjligt att hamna i en situation där algoritmen ej berättar vad som ska göras.

• Entydig: Alla som arbetar med algoritmen ska vara överens om vad som ska göras. Inga dispyter bör förekomma.

• Deterministisk: Endast ett resultat är möjligt. Instruktioner ska leda till en lösning som alltid gäller. Att kasta tärning är icke-deterministiskt eftersom varje gång tärningen kastas fås en ny sida.

7

• Ändlig: Instruktioner ska ej följas i all evighet. När en algoritm följs ska den leda fram till ett slut.

Ett exempel på en enkel algoritm ges av Ola Wikander (2013): ATT KOKA POTATIS

Sätt på vattenkranen

UPPREPA: Häll vatten i kastrull TILLS kastrullen är full Stäng av vattenkranen

Ställ kastrullen på kokplattan Vrid på värmen

Lägg på locket

UPPREPA: Värm vattnet TILLS vattnet kokar Sänk värmen

Lägg i potatisen

Inom programmering och datavetenskap är algoritmer en central del. Finn (2017) menar att de finns överallt, de dominerar aktiemarknaden, de komponerar musik, de finns i självkörande bilar och de kan skriva egna nyhetsartiklar. Byers (2010) anser att några av dagens stora tekniska framsteg involverar skapandet av algoritmer, eftersom algoritmer genomsyrar hela konceptet med programmering av datorprogram.

2.3 Internet of Things

Internet of Things (IoT) är precis som artificiell intelligens ett stort begrepp som innefattar flera tekniska aspekter. IoT är ett begrepp som innebär en sammankoppling mellan fysiska artefakter i ett nätverk. I artikeln Artificial Intelligence in Internet of Things (Gosh et al., 2018) beskrivs fyra förhållande som en fysisk artefakt måste inneha för att kunna definieras som en IoT-enhet. Dessa faktorer innebär att den fysiska enheten bör kunna:

• Generera eller samla in data • Behandla data

• Skicka eller ta emot data • Identifiera sig själv

Atlam, Walters, & Wills (2018) beskriver att IoT kan förklaras genom fem olika nivåer eller former som IoTs system arkitektur utgör.

• Perception: Den första nivån är den fysiska artefakten som oftast innebär någon form av sensor som t.ex. RFID, 2D barcode eller infraröda sensorer. Det är genom dessa sensortekniker som datainsamlingen av t.ex temperatur, rörelse, acceleration, humiditet eller kemiska förändringar i luften sker. Denna data förs därefter över till nätverksnivån av IoT-enheten.

• Nätverk: Efter att den eftersökta datan insamlats behöver den överföras till en databehandlings-enhet i detta fallet även kallat “middleware” nivån. Detta kan göras genom t.ex Wi-Fi, Bluetooth eller 3G/4G.

• Middleware: Datan tas emot av en databehandling-enhet som utför lämplig processering av datan för att sedan kategorisera informationen i databaser. Det är även i detta stadiet som eventuella viktiga beslut tas av den implementerade mjukvaran utefter den inhämtade informationen från nätverks-nivån. Denna form av databehandling kallas även Real-time Operational DataBase (RODB).

• Applicering: Nästa nivå definieras som området den utvunna datan från föregående stadie sedan används. Ett par exempel på dessa områden är smarta hem, uppkopplade bilar, smart energihantering, e-hälsoverktyg och intelligenta transportsystem.

• Beslutsfattande: Det sista stadiet är där det faktiska värdet av framgångsrika IoT-system uppenbarar sig. Genom att producera grafer, affärsmodeller och flödesscheman kan datan som

8

genererats genom föregående nivåer bli förståeliga beslutsunderlag för verksamheter och användarna av tjänsten (ibid).

2.4 EU:s etiska ramverk

Europeiska Unionen (EU) publicerade i april 2019 ett direktiv som berör utveckling och användande av AI inom EU. Direktivet är producerat av en framstående expertgrupp inom AI med 51 medverkande som bidragit med mer än 500 kommentarer. Direktivet är en bearbetning som önskar bidra med riktlinjer till hur pålitlig AI kan säkerställas. För att skapa ett förtroende för AI menar de att AI måste följa alla lagar, respektera alla etiska principer och vara robust både från ett tekniskt perspektiv men också från dess givna sociala miljö. Bland annat så innehåller direktivet ett etiskt ramverk som verksamheter bör förhålla sig till för att säkerställa att de AI-system som implementeras idag upprätthåller ett etiskt förhållningssätt. I detta dokument är det tre punkter som ska ligga till grund för EU:s förhållningssätt till AI:

• Vara i framkant i den teknologiska utvecklingen och uppmuntra applicering inom publika och privata sektorn.

• Förbereda inför de socioekonomiska förändringar AI medför. • Säkerställa ett etiskt och rättsligt ramverk

Det etiska och rättsliga ramverket som producerats är inte fastställt som lag utan är i dagsläget endast tänkt som ett ramverk för verksamheter och nationer att förhålla sig till. Det etiska ramverket utgår ifrån sju huvudpunkter:

Mänsklig kontroll och översikt

Enligt ramverket bör AI stödja mänskligt självstyre och bestämmanderätt. Utvecklande av AI bör också ha fundamentala rättigheter i åtanke. I situationer där det finns risk att AI-system kan påverka dessa fundamentala rättigheter bör en särskild utvärdering göras. AI system bör göra det möjligt för människor att kunna fatta bättre, mer informerade beslut i enlighet med deras utsatta mål. I vissa fall kan AI utvecklas för att forma och influera mänskligt beteende genom mekanismer som använder sig av manipulation eller liknande. Detta bör motverkas och principen om användarens självstyre bör vara centralt i systemets funktionalitet. AI system bör dessutom kontrolleras med någon form av mänsklig kontroll för att försäkra sig om att AI-systemet inte undergräver människors självstyre. Denna mänskliga kontroll kan komma i tre former:

1. Human In The Loop (HITL): Människan har direkt kontroll över varje beslut som tas av systemet.

2. Human On The Loop (HOTL): Människan har direkt kontroll över systemets design och insikt i systemets drift.

3. Human In Command (HIC): Människan har total kontroll över hela systemet. Detta inkluderar systemets bredare effekter i ekonomiska, sociala, legala och etiska kontexter.

Teknisk robusthet och säkerhet

AI-system, likt många andra it-system, behöver skyddas mot sårbarheter som möjliggör potentiella hot från hackare. AI-system bör också ha en reservplan ifall systemet stöter på problem. Detta kan innebära att systemet skiftar från att fatta statistiskt baserade beslut till regelbaserade beslut eller skicka en varning till behörig mänsklig kontrollant som i sin tur måste godkänna systemets nästa steg. Systemets pricksäkerhet syftar till dess förmåga att fatta korrekta beslut. Även ifall inkorrekta beslut är oundvikligt är det viktigt att systemet kan uppvisa till vilken sannolikhet dessa fel kan uppstå. Det är också kritiskt att besluten som AI-systemet tar kan återskapas och är tillförlitliga. Detta behövs för att kunna granska ett system och förebygga potentiella skaderisker.

Integritet och Data Governance

AI-system måste garantera integritet och säker datahantering genom hela systemets livscykel. Detta inkluderar information som initialt tillhandages av användaren och den data som i sin tur produceras i relation till dataanalysen av användardatan. När data samlas in finns det risk att kvalitén av datan är

9

påverkad genom t.ex felaktigheter, misstag eller partiskhet. Dataintegriteten måste kunna garanteras genom att grundligt testa processer och insamlad data. I varje organisation som hanterar data måste ett givet dataprotokoll införas som fastställer vem som har tillgång till vilken data och under vilka omständigheter.

Transparens

De dataset, algoritmer och processer som innefattar underlaget till AI:ns beslut bör dokumenteras till högsta möjliga standard för att möjliggöra spårbarhet och därmed utöka AI:ns transparens. Att kunna förklara tekniska aspekter i systemet kräver att beslut som togs av AI:n kan förstås och spåras av människor. Det är möjligt att kompromisser behöver göras genom att minska AI:ns pricksäkerhet för att öka förmågan att kunna förklara hur beslut togs av AI:n. När en AI har förmågan att kunna ha en betydande effekt på människors liv borde en förståelig förklaring bakom beslutet till den berörda människan kunna ges. Dessutom bör AI-systemets kapaciteter och begränsningar tydligt kommuniceras till användaren.

Diversitet, icke diskriminerande och rättvisa

För att uppnå tillförlitlig AI behöver systemet vara inkluderande och icke diskriminerande. För att uppnå detta behöver AI-systemet även designas med inklusivitet i åtanke och garantera att jämställd tillgång till systemet erbjuds, givet satta dataprotokoll. AI-system bör utvecklas med att exkludera partiskhet i systemet beslutsprocesser. Partiskhet kan uppstå i nedärvda åsikter från utvecklaren eller genom bristande programmering och konstruerande av algoritmer. För att motverka partiskhet bör särskilda översiktsprocesser implementeras som granskar systemets syften och beslutsprocesser på ett klart och transparent vis. Vidare bör organisationer uppmuntras att anställa personal från olika bakgrunder, kulturer och discipliner vilket kan bidra till en diversitet av åsikter. För att systemet ska vara pålitligt bör även systemets intressenter konsulteras under både utvecklingsprocessen och löpande under systemets användning.

Social- och miljöhälsa

Utveckling av AI-system bör vara medvetna om och ha i åtanke sin yttre miljö. Andra medvetna varelser och miljön bör anses vara intressenter till systemet. Hållbarhet och ekologiskt ansvar bör uppmuntras vid utveckling av AI-system. AI-system bör uppmuntras till att användas i goda ändamål som inte endast gynnar vår generation, utan även framtida generationer. AI-system kan också i vissa fall användas till att förstärka sociala färdigheter men kan också å andra sidan bidra till socialt förfall. Effekterna från AI-system löper risk att orsaka psykisk ohälsa i vissa fall och viss övervakning av effekterna ett AI-AI-system har i en social kontext bör appliceras i fall där det bedöms nödvändigt. Utöver effekterna ett AI-system kan ha på individer bör även dessa effekter undersökas ur ett samhällsperspektiv. Effekterna av AI-system bör särskilt bevakas när det används i situationer som berör demokratiska processer.

Ansvarighet Kravet på ansvar kompletterar ovanstående huvudpunkter och betonar att mekanismer för hur

ansvarsfördelning över AI-systemets effekter bör ske under både utvecklings-, implementerings- och användningsfasen måste fastställas. I fall där fundamentala rättigheter eller säkerhetskritiska funktioner påverkas bör särskild granskning utföras av AI-systemets algoritmer, data och designprocess. Detta innebär inte nödvändigtvis att företags affärsmodeller och/eller immateriella rättigheter måste vara öppet tillgängliga. Vidare bör möjligheten för rapportering av handlingar eller beslut skapat av systemet och konsekvenserna av detta vara säkerställt. Även möjligheten att kunna svara på dessa rapporteringar måste vara säkerställt. Det är ytterst viktigt att visselblåsare bland anställda är berättigade att få sin röst hörd. När ovan ställda krav implementeras i utvecklingsprocessen av AI-system kommer det oundvikligen uppstå situationer där kompromisser måste göras. Beslutstagaren i dessa fall bör alltid inneha ansvaret och bör därmed kontinuerligt följa upp beslutets effekter. Slutligen bör det alltid finnas en möjlighet att avhjälpa när systemet har en orättvis och allvarlig inverkan.

10

2.5 Etik

Begreppet etik avser studerandet av moral. Etik kommer från grekiskan ethos och moral från latinskan mores. Enligt Tavani (2013) innebär moral ett system som innehåller regler om uppförande, och principer för att evaluera de reglerna. Vidare definierar författaren cyberetik som studerandet av moraliska, legala och sociala frågor som involverar cyberteknologi, där cyberteknologi avser datoriserade och kommunicerande enheter såsom bland annat smartphones, iPods och datorer. Cyberetiken utvärderar, via olika etiska teorier, den påverkan som cyberteknologin har på morala, juridiska och sociala system. Etiska teorier syftar till att upprätta standarder och regler för att evaluera moraliska problem. Enligt författaren finns det fyra etiska teorier: (1) Konsekvensbaserad, (2) Pliktbaserad, (3) Kontraktbaserad och (4) Karaktärsbaserad. För vår studie ämnar vi använda konsekvensbaserad- och pliktbaserad etik som etiska teorier för att jämföra hur olika forskare på olika geografiska områden ser på etiken inom teknikerna.

Konsekvensbaserad etik

Med konsekvensbaserad etik är det primära målet med ett agerande eller policy att producera den mest önskvärda konsekvensen för sina medlemmar. Teorin bygger på konceptet att en individuell åtgärd (X) eller social policy (Y) är moraliskt godtagbar om konsekvensen från (X) eller (Y) producerar den största nyttan för den största mängden individer som påverkas av åtgärden eller policyn. Inom konsekvensetiken finns det olika skolor, varav utilitarismen är en av de största (Tavani, 2013). Vidare kan utilitarismen delas in i två typer:

1. Handlings utilitarism (Act Utilitarianism) – En handling är moraliskt godtagbar om konsekvenserna som produceras genom att utföra (X) resulterar i den största mängden nytta för den största mängden individer som påverkas av (X).

2. Regelutilitarism (Rule Utilitarianism) – Här anses regler eller principer som den viktigaste faktorn, inte konsekvenser. En handling, (X), är moraliskt godtagbar om konsekvenserna av att följa den generella regeln (Y), skapar den största nyttan (Tavani, 2013).

Pliktbaserad etik

En av de mest kända förespråkarna för pliktetik är Immanuel Kant. Enligt Kant grundas moral i den plikt eller skyldighet människor har gentemot varandra. Han bygger sin teori på att människor är rationella varelser och att människor inte ska utnyttja varandra för sitt eget bästa (Tavani, 2013).

3 Forskningsmetodik

För vår undersökning har vi valt att använda ett antal metoder, så kallad metodtriangulering för att nå ett bättre resultat. Till en början var en litteraturstudie i fokus för att granska det nuvarande kunskapsläget och ge oss en kunskapsbas. Vidare samlades empirisk data in via kvalitativa forskningsintervjuer på Innovation Skåne och Tieto samt använde vi artiklarna från litteraturstudien som forskarnas röster.

3.1 Vetenskaplig ansats

Empiriska data samlades in via kvalitativa forskningsintervjuer med semistrukturerad intervjuguide. Denscombe (2016) definierar forskningsintervju som en metod för datainsamling som använder människors svar på forskarens frågor som datakälla. Studien utgick från ett fenomenologiskt perspektiv. Fenomenologi innebär att beskriva grunddragen i vissa typer av personliga erfarenheter, att förstå något genom någon annans ögon (Denscombe, 2016). Vi valde att fokusera på fenomenologi eftersom vi ansåg att detta perspektiv passade bäst för vårt mål med studien, att få en bild av hur experter värderar etik och säkerhet när artificiell intelligens integreras med Internet of things.

11

3.2 Datainsamling

3.2.1 Sekundärdata

Sekundärdata innebär att källan är en andrahandskälla som pekar tillbaka på en eller flera primärkällor. Sekundärkällor bygger vidare på primärkällor, t.ex. genom att summera, analysera eller kritiskt granska dessa (Umeå universitetsbibliotek, u.d). Vår sekundärdata bestod av vetenskapliga artiklar som publicerats mellan åren 2005 och 2018. Vi har utfört en litteraturstudie, eller forskningsöversikt som det också kallas, för att kunna kritiskt granska och tolka insamlat material. Litteraturstudien var en utgångspunkt för vår studie att utveckla relevanta intervjufrågor som förväntades ge oss svar på den frågeställningen studien ämnar besvara. Enligt Backman (2016) syftar litteraturstudien till att sammanställa all litteratur som finns inom ett givet område. Vidare poängterar författaren att betoningen således ligger på att framställa en komprimerad sammanställning av exempelvis resultat eller använda metoder.

3.2.2 Semistrukturerade intervjuer

Studien kommer söka djupare förståelse genom att intervjua experter inom området och syntetisera deras kunskap med den identifierade kunskapen från litteraturstudien. Studien ämnar att utföra sex intervjuer med respondenter som förväntas besitta utvecklad kunskap om Internet of Things, artificiell intelligens och integrationen som sker mellan dessa tekniska aspekter. Enligt Denscombe (2016) finns det tre former av strukturer på intervjuer: strukturerad, semistrukturerad och ostrukturerad. I denna studien var en semistrukturerad intervju utgångspunkten. En semistrukturerad intervju innebär enligt Denscombe (2016) att forskaren har inför intervjutillfället förberett ämnen och frågor till respondenten men till skillnad från strukturerad intervju låter forskaren respondenten utveckla sina svar inom de diskussionsämnen som forskaren initierar. Som underlag för våra intervjufrågor har vi delvis använt oss av European Commissions (2019) etiska riktlinjer. Frågorna kommer framställas i en intervjumall (Bilaga 1) vi avser använda under intervjutillfället.

3.3 Genomförande

Intervjuerna har genomförts med olika metoder. Vi har delvis använt oss av Skype för den personen som befann sig långt bort från Malmö och för personen inom Malmö med omnejd har intervjuen genomförts på företaget. Intervjutiden begränsade vi till en timme vilket vi kände var lagom nog att få svar på våra frågor. Ingen av intervjuerna har överstigit tidsgränsen. Intervjun ägde rum i ett privat rum med endast oss och respondenten i fråga.

3.4 Urvalsdiskussion

Mot bakgrund av vårt metodval kommer både primär- och sekundärdata att samlas in. Primärdata inhämtas från våra intervjuer och den sekundära datan kommer från vetenskapliga artiklar skrivna av forskare. Vi har i vår undersökning valt att använda oss av en subjektiv urvalsprocess då vi på förväg visste vilka vi skulle kontakta för intervju. Ett subjektivt urval innebär att urvalet fungerar utifrån principen att man kan få den bästa informationen genom att inrikta sig på ett relativt litet antal personer som avsiktligt har valts ut med utgångspunkt i deras kända kännetecken (Denscombe, 2016). Intervjuerna begränsades initialt till sex stycken, detta för att kunna sondera varje respondent på djupet. Dock fick vi endast kontakt med fyra av våra tänkta respondenter, tre forskare och en inom näringslivet, vilket gjorde att vi fick utföra en textanalys av vetenskapliga artiklar, med avsikt att använda dessa artiklar som forskarnas röster istället. Vi kontaktade totalt 20 personer om deras intresse att medverka i studien. Trots att vi använde artiklar som forskarnas röster kunde vi ändå identifiera deras uppfattningar och inställningar om hur etiken värderas. Därmed kunde vi hålla oss till samma tema som ursprungligen var avsett.

12

Genom att tillämpa ett lämplighetsurval har vi kunnat identifiera de artiklar som vi ansåg föll inom ramen för vår undersökning. Via inkluderings- och uteslutningskriterier har vi kunnat precisera de artiklar vi ansåg vara bäst lämpade för undersökningen. Efter att en preliminär fråge-eller problemställning har identifierats lokaliseras centrala termer i denna. Här gäller det att finna just de termer som är relevanta och helst precisa på det område man avser att inventera (Backman, 2016). Vi satte ett minimumkrav på att 40 stycken artiklar skulle läsas och att artikelsökningen skulle sträcka sig från åren 2005–2018, varpå titeln och abstracten från varje artikel noggrant skulle läsas igenom för att kunna bedöma deras relevans för vår studie. De artiklar vi valt har befunnit sig i spannet mellan 2015-2018. Åtta stycken av de artiklar vi hittade ansåg vi vara relevanta för undersökningen. Vid läsningen av artiklarna utgick vi från de etiska teorierna, konsekvensetik och pliktetik, för att kunna identifiera etiska diskurser.

Uteslutningskriterier var tvunget att tillämpas då AI och IoT är paraplybegrepp och innefattar flera olika tekniker. Artiklarna avgränsades till maskininlärning och sensorer som samlar in data.

Sökord som tillämpades för studien var: machine learning, Internet of Things, ethics and AI, ethics and IoT, AI integrated with IoT och ethics in AI integrated with IoT. För att uppnå en så kraftfull sökning som möjligt har en operator använts. Operatorer är ord som and, or och not. Dessa kallas även Booleska efter upphovsmannen (Backman, 2016). För denna studien har operatorn and använts för att inkludera fler precisa sökträffar samt exkludera irrelevanta träffar. Det fanns inget behov av att precisera ytterligare sökord då dessa gav tillräckligt med relevanta artiklar för studien. Litteratursökningen har begränsats till två specifika databaser, IEEE och Google Scholar, då dessa kändes som ett naturligt och effektivt val. IEEE är en global organisation avsedd att bistå med vetenskaplig information relaterat till det tekniska fältet. Google Scholar användes då vi är bekanta med databasen sedan tidigare.

Genom att utöka sökperioden till exempelvis 1990 när teknikerna fortfarande var nya hade möjligtvis resultatet kring den etiska diskursen i dessa artiklar sett annorlunda ut. Vi hade som målsättning med litteratursökningen att identifiera forskare från olika länder och världsdelar för att få en bredare syn på etisk användning av AI och IoT. Vi lyckades identifiera etiska diskurser från forskare med spridda nationaliteter med två artiklar från USA, två från Sverige, två från Indien, en från England och en från Australien. Ett potentiellt viktigt perspektiv som studien kan ha missat är det kinesiska perspektivet. Då Kina är mycket framstående inom AI utveckling och har applicerat flera stora AI-verktyg som bland annat vår Respondent 1 poängterade hade deras perspektiv på etisk användning av AI varit önskvärd. I sökningen efter artiklar kunde ett par kinesiska artiklar identifieras. Däremot saknade dessa artiklar en etisk diskurs och var mer tekniskt inriktade. En mer specifik sökning efter det kinesiska perspektivet på etisk AI hade behövt göras.

4 Dataanalys

Enligt Denscombe (2016) finns det ett flertal olika typer av analysmetoder som forskare kan använda. Ofta rör det sig mellan kvalitativ eller kvantitativ forskning. Eftersom vi använt oss av sekundärdata i form av vetenskapliga artiklar och intervjuer som datainsamlingsmetoder mynnar det ut i en kvalitativ dataanalysmetod för att tolka och presentera data. I enlighet med vår studies syfte ter det sig naturligt att använda en kvalitativ studie eftersom denna typen av studie använder ord eller visuella bilder som analysenhet. Alla intervjuer har spelats in med respondenternas samtycke. Ljudinspelningarna från intervjuerna har transkriberats och analyserats. Enligt Denscombe (2016) gör transkriberingar det lättare att genomföra detaljerade sökningar och jämförelser mellan data. Då intervjuerna var av semistrukturerad karaktär förekom det ett par gånger att respondenten gick in i andra teman än de vi efterfrågade. Dessa teman hade dock en viss relevans för vår undersökning. För att hitta likheter och olikheter i det inspelade materialet följde vi en enkel textanalys som omfattade sex steg. Dessa steg använde vi även för analysen av artiklarna och presenteras nedan:

13

1. För att få en förståelse kring materialet läste vi noggrant igenom alla relevanta artiklar som identifierats enligt kriterier presenterade i urvalsdiskussionen.

2. Efter att vi noggrant gått igenom alla relevanta artiklar plockade vi ut de vi ansåg ha en viss relevans för vår frågeställning. Då mycket av texterna innehöll data som vi ej ansåg vara relevant för vår frågeställning behövde en bortsortering utföras.

3. Efter sorteringen plockade vi ut specifika meningar som vi ansåg hade en direkt anknytning till möjligheter, utmaningar och etiska aspekter med teknikerna.

4. Efter det tredje steget kunde vi hitta lämpliga kategorier, eller teman. För att kunna hitta likheter och olikheter i artiklarna var vi tvungna att hitta olika mönster och samband i våra teman. Från början identifierade vi åtta stycken.

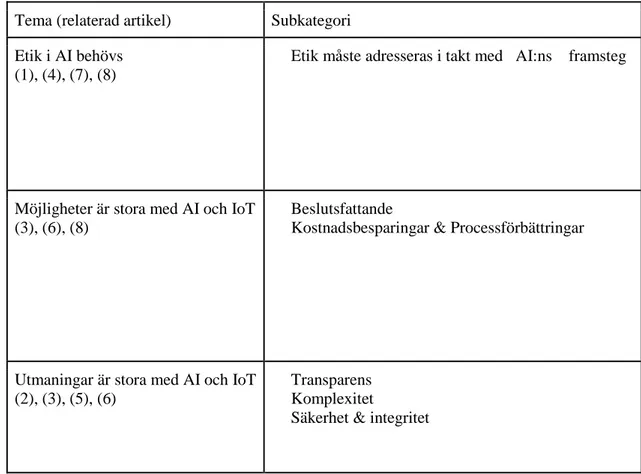

5. Efter en noggrann genomgång kunde vi korta ner våra teman till tre stycken. Dessa är: etik i AI behövs, möjligheter är stora med AI och IoT och utmaningar är stora med AI och IoT. Efter detta steget försökte vi hitta lämpliga kategorier, eller teman.

6. Det sista steget innefattade en process där vi skapade subkategorier från de teman vi identifierat. I resultatdelen presenterar vi våra teman och de tillhörande subkategorierna i en tabell.

5 Resultat

Siffrorna i tabellen relaterar till de artiklar som adresserar temat. Artiklarna presenteras under tabellen. En kort beskrivning av artiklarnas relation till våra identifierade teman presenteras under litteraturstudien och vidare fördjupas artiklarna i jämförelsen med EU:s etiska ramverk i analysen. Därefter följer insamlad empiri från de två utförda intervjuerna.

5.1 Litteraturstudie

Nedan följer en lista artiklar som behandlas i en tabell utefter tema och specifika subkategorier som sedan presenteras i efterföljande delkapitel.

Artiklar:

1. “Ethics Aspects of Embedded and Cyber-Physical Systems” Thekkilakattil,. A., Dodig-Crnkovic, G., 2015, Sverige

2. “Applying Internet of Things and Machine-Learning for Personalized Healthcare: Issues and Challenges”Ahamed, F., Farid, F., 2018, Australien

3. “A Review on Machine Learning Trends, Application and Challenges in Internet of Things” Reddy, R. R., Mamatha, C., Reddy, R. G., 2018, Indien

4. “Toward Applied Cyberethics” Hurlburt, G., 2018, USA

5. “Software engineering challenges of deep learning” Arpteg, A., Brinne, B., Crnovic-Friis, L. & Bosch, J., 2018, Sverige

6. “Intelligence of Things: Opportunities & Challenges” Atlam, H.F., Walters, R.J. & Wills, G.B., 2018, England

7. “Ethical aspects and future of artificial intelligence” Kumar, N., Kharkwal, N., Kohli, R., Choudhary., 2016, Indien

8. “The Internet of Things, Artificial Intelligence, Blockchain, and Professionalism” Daniels, J., Sargolzaei, S., Sargolazaei, A., Ahram, T., Laplante, P. A., Amaba, B., 2018, USA

14 Tema (relaterad artikel) Subkategori Etik i AI behövs

(1), (4), (7), (8)

- Etik måste adresseras i takt med AI:ns framsteg

Möjligheter är stora med AI och IoT (3), (6), (8)

- Beslutsfattande

- Kostnadsbesparingar & Processförbättringar

Utmaningar är stora med AI och IoT (2), (3), (5), (6)

- Transparens - Komplexitet

- Säkerhet & integritet

Figur 2. Tabellen visar teman och dess subkategorier vi identifierat från litteraturstudien.

5.1.1 Etik i AI behövs

Etik måste adresseras i takt med AI:s framsteg

Samtidigt som fantastiska möjligheter skapas med AI och IoT uppstår allvarliga avväganden som bör adresseras. Möjligheter bör ställas mot etiska avväganden. Flera forskare anser att etik är något som bör genomsyra hela utvecklingen av teknikerna. Hurlburt (2018) nämner att cyberetik är den saknade länken i teknikernas hastiga utveckling. Thekkillakattil et al. (2018) menar att det är viktigt att de för att garantera en så hög pålitlighet som möjligt måste personal som jobbar med att utveckla AI-system följa etiska standarder. Detta får medhåll från Kumar et al. (2016) som påpekar att det är viktigt att etiska problem proaktivt motverkas genom att skriva passande kod och se till att etiska frågor testas ordentligt. Kumar et al. (2016) lyfter också ett exempel på en etisk fråga som de anser vara delad i den aktuella debatten kring AI, nämligen frågan om autonoma vapensystem. Ena sidan påpekar att ett autonomt vapensystem hade varit mer effektivt och kan minimera antalet civila offer. Och de som bestrider användandet av autonoma vapensystem menar att det hade gjort det möjligt för terrorister att utnyttja teknologin och att det strider mot fundamentala principer om mänsklig värdighet (ibid). “Dessa teknologier måste lösa problem de ställs inför inom de ramar av etik som bär vårt samhälle idag med ett ansvar att skydda allmänhälsan, trygghet, säkerhet och miljön med en minimum standard av omtanke som i slutändan alltid styrs av människor i ett konstant utvecklande nätverk” (Daniels, J., et al, 2018).

15 5.1.2 Möjligheter är stora med AI och IoT Beslutsfattande

Enligt Atlam et al. (2018) producerades 1 miljard terabyte data från IoT-enheter och datan förväntas öka ännu mer de nästkommande åren. Detta ställer höga krav på att effektivt kunna fatta beslut kring datan. Författarna menar att AI är ett kraftfullt verktyg som kan användas i beslutsfattande syfte. Författarnas argument får medhåll från Reddy et al. (2018) som menar att AI kan upptäcka mönster i stora mängder data och fatta beslut kring dessa.

Kostnadsbesparingar & Processförbättringar

Idag finns det flera marknadssegment som tar tillvara på AI integrerad IoT i sina verksamheter bland annat tillverkningsindustrin, sjukvården, finansiella tjänster, livsmedelsindustrin och fordonsindustrin (Daniels, J. et al., 2018). Genom att effektivisera processer finns möjligheten för kostnader att minska. Att förse byggnader med smarta sensorer kan öka säkerheten och minska riskerna som till exempel eldsvådor och översvämningar. Detta i sin tur leder till minskade driftskostnader och effektivare energiförsörjning (Atlam et al., 2018). Hurlburt (2018) menar att kombinerade teknologier som AI och IoT inte bara skapar kostnadsbesparingar och processförbättringar utan kan helt eliminera vissa yrken som t.ex revisorer. “Kombinerade system idag som t.ex smarta kylskåp använder sig av IoT-sensorer för att analysera innehållet, blockchain för att garantera datans integritet och att den levereras på korrekt sätt till en AI som sedan levererar deskriptiv, prediktiv och normativ information om hur systemet bör reagera” (Daniels, J. et al, 2018).

5.1.3 Utmaningar är stora med AI och IoT Transparens

Då många AI-system idag är byggda med någon form maskininlärning är det inte alltid lätt att ta reda på logiken och meningen bakom de abstraktionslager som utgör vilket beslut som AI:n kommer att ta (Arpteg et al., 2018). Många av de framsteg som har gjorts inom AI är tack vare att man övergivit den mer modulära utvecklingsprocessen till maskininlärningstekniker som neural network och deep learning. Men utbytet som görs för att dessa AI-system ska ha hög precision är sämre insyn i systemets beslutsprocesser, vilket också kallas systemets transparens (ibid). Problemet med transparens ses som en systemutvecklings utmaning av Arpteg et al. (2018). Det finns å andra sidan de forskare som även ser ytterligare utmaningar med dålig transparens i ett AI-system.

Komplexitet Datorer har inga känslor. Vi människor baserar beslut på känslor, tankar och etiska värderingar. Dessa

faktorer kan framträda i AI:ns träningsdata. En komplexitet ligger i att göra AI:n så självständig som möjligt. Gemene man tenderar att se AI som en blackbox, vilket innebär svårigheter med att förstå tekniken. Detta sätter deras säkerhet på spel (Reddy et al., 2018). Arpteg et al. (2018) visar på ytterligare komplexitet då de menar att det är mycket svårt att felsöka en AI då det i många fall kräver att man går igenom miljontals parametrar.

Säkerhet & Integritet

Säkerhet och integritet är en av de största utmaningarna som AI integrerad IoT står inför idag (Reddy, R., Mamatha, C. & Reddy, G., 2018; Atlam et al., 2018; Arpteg et al., 2018). Att AI står inför utmaningar gällande säkerhet och integritet är en återkommande problematik som är svår att undvika. I stora AI system kan det inte alltid skapas en förståelse över systemets mekanismer (se ovan, Transparens) vilket innebär att systemet kan bli svårt att kontrollera (Arpteg et al., 2018). När AI och IoT sedan kombineras är det extra viktigt att kunna garantera integritet för sina användare. Som Atlam et al. (2018) uttrycker det samlar inte smarta IoT-enheter bara in data som berör vår miljö utan också information som berör våra livsvanor, finansiella situation, hälsosituation och annan känslig information som kan beröra oss människor på en personlig nivå. Även Ahamed & Farid (2018) beskriver att en stor utmaning gällande dessa AI integrerade IoT-lösningar inom sjukvården är att den information som produceras och

16

kommuniceras mellan enheterna i systemet i vissa fall är väldigt känslig. Hurlburt (2018) menar att säkerhetsåtgärder ligger efter i utvecklingen idag och då cyberattacker ökar både i frekvens och komplexitet menar han att det blir det extra viktigt att ta tag i denna problematiken. Samtidigt som lagar som GDPR går långa vägar för att skydda integritet och öka säkerheten menar vissa forskare att dessa lagar skapar hinder för utvecklare då kraven på systemets sätt att hantera information (Arpteg et al., 2018).

5.2 Intervju

5.2.1 Ett perspektiv från en expert inom Innovation Skåne.

Respondenten är nytillsatt ordförande i styrelsen för Innovation Skåne. Personen i fråga har lång erfarenhet och har jobbat ca 30 år inom mobilbranschen och i ledande positioner på bland annat Sony och Ericsson. Hans uppgift inom Innovation Skåne är att utveckla ledarskapet som Innovation Skåne tagit i gränslandet mellan regional tillväxt och innovation i hälso- och sjukvård. Vidare vill han bidra till att driva utvecklingen mot att Skåne blir platsen där innovation händer inom både offentlig förvaltning och näringsliv.

I intervjun med Respondent 1 framkom det att de i nuläget är framförallt intresserade av att implementera AI inom två projekt. Det ena projektet handlar om något de kallar cyklisk matproduktion. Cyklisk matproduktion beskriver Respondent 1 som, i deras exempel, när restprodukter från en odling av ärtor går till insekter, insekterna går sedan till en fiskodling på land där sedan fiskens avföring går tillbaka till odlingen av ärtorna. I denna cykliska process finns det många faktorer som påverkar delmomenten i processen som till exempel salthalten och temperaturen i fiskodlingens vatten eller regleringen av den perfekta balansen av animaliskt och växtbaserat protein till fiskarna. För att optimera dessa delmoment önskar de använda sig av en AI som bland annat är kopplat ut till dessa delmoment för att distribuera rätt värden eller liknande. Ett annat exempel som Respondent 1 lyfte var ett projekt där de planerar att införa eldrivna tunga fordon inom Lunds kommun som till exempel bussar och sopbilar. För att ladda dessa fordon skulle det användas en laddnings-strip i vägen som innebär att fordonet kan laddas medan det körs. Men för att det inte ska uppstå stora köer av bussar som behöver laddas om det står en stor sopbil och laddar har de tittat på lösningar med AI för att optimera trafikflödet av regionens fordon. Detta projekt var fortfarande i sitt uppstartsskede men en lösning de tittade på var att genom en IoT-enhet som en GPS-sändare skicka information om fordonets position till en AI som med hjälp av en karta med övriga fordonsposition och laddningstillstånd dirigera trafiken optimalt. Respondent 1 menar att en etisk problematik ligger i de avancerade elektroniska ID-korten som personal på vissa kinesiska sjukhus bär. Han menar att korten kan spåra personalens exakta läge. Vidare ställer Respondent 1 sig väldigt kritisk till värnandet av patienternas integritet. Han menar att idag prioriteras patienters integritet över deras välmående. Med detta anser han att datan som produceras är viktigare än patientens välmående. Ur ett säkerhetsperspektiv förklarar respondent 1 att IoT i kombination med AI kan potentiellt orsaka katastrofala problem. Han ger som exempel ett flygplan vars sensorer kan hänga sig och datan från sensorerna kan misstolkas.

När det kommer till människans värde i en AI styrd framtid menar respondent 1 att så länge AI:n fungerar som ett stödsystem till folk behöver inte människan vara orolig för sitt jobb. Han ger autopiloter som ett exempel där människans värde ej förringas. Respondent 1 drar paralleller med beslutsstödsystem vilka kan vara avgörande och få stora konsekvenser. Genom att jämföra för- och nackdelar kan beslutstagandet underlättas. Här anser Respondent 1 att artificiell intelligens bland annat kan bistå med hjälp för vårdpersonal. Till exempel kan läkare använda bildigenkänningsprogram för att jämföra lungcancerbilder, genom att få in data från alla sjukhus kan en jämförelse göras av 20 000 bilder. Jämförelsen kan sedan generera svar på frågor som vilka har haft lungcancer, vilka har inte haft lungcancer och vad bör observeras i framtiden.

17

AI:n i dagsläget är i de flesta fall för omogen för att kunna ersätta människan helt och hållet, menar Respondent 1. Bland annat lyfter han fram problematiken med att implementera moral och etik i en självgående AI. Människan har ett rationellt tänkande vilket brister i dagens AI-algoritmer. Ytterligare problem enligt Respondent 1 ligger i att programmera AI:n så att den inte tar absurda beslut. Dock pekar han på ett intressant exempel som illustrerar AI:ns möjligheter till att vara självgående och självlärd. För ett par år sedan byggde Google en superdator vid namn AlphaGo. Datorns uppgift var att slå den regerande mästaren i spelet Go, vilket den gjorde. Det intressanta ligger i att Google en period efteråt byggde en annan dator, AlphaGo Zero. Denna datorns uppgift var att vinna över den första datorn, vilket den gjorde, men poängen ligger i att den andra datorn lärde sig att spela spelet enbart från den första datorn, utan människans inblandning.

5.2.2 Ett perspektiv från en expert inom Tieto.

Den andra intervjun vi utförde var med en person som leder alla globala AI-utvecklingar och innovation på Tieto. Han är adjungerad professor och forskarassistent. Han anser att det är extremt spännande att studera någonting som kan vara självlärande och som kan utföra uppgifter och göra bestämmelser som egentligen bara vi människor kan göra. År 2019 valdes han som topp 100 globala ledare inom artificiell intelligens bland andra globala AI ledare. Vidare har Respondent 2 25 års erfarenhet inom fältet artificiell intelligens.

Respondent 2 berättar att de har vid tidigare tillfällen jobbat med projekt som involverat smarta IoT-lösningar inom tillverkningsindustrin och hissreparationer. De har använt sig av maskininlärningsprogram för att identifiera mönster inom bl.a livscykelhantering av maskiner och hissar. Då har data samlats in från maskinerna och hissarna som analyseras och sedan förutspår när vissa komponenter behöver bytas ut innan de går sönder. Respondent 2 lyfter även ett annat exempel på en smart IoT-lösning som använts i Göteborgs landsting där de installerat IoT-enheter i hemmet hos kroniskt sjuka patienter som avläser huruvida patienten har tagit sin medicin eller inte och kan påminna patienten själv eller anhöriga.

Respondent 2 beskriver i intervjun att det finns anledning att vara extra medveten och noggrann med säkerheten angående självkörande bilar i framtiden. Han anser inte att det är en utmaning idag då vi inte har ett särskilt stort antal självkörande bilar utan snarare ett problem om kanske 5-10 år. Respondent 2 menar att det bör appliceras särskild säkerhet kring självkörande bilar när det i framtiden kommer existera större företag med fordonsparker som kan utsättas för en hackerattack.

När det kommer till att förlita sig på AI-lösningar utan mänsklig bevakning i framtiden anser Respondent 2 att man bör förhålla sig relativt till detta. Å ena sidan finns det redan idag AI-system som man med god anledning kan förlita sig på och lämna utan mänsklig övervakning. Som exempel tar han upp chatbottar som används som support när besökare har frågor under sin vistelse på det sagda företagets hemsida. I dessa fall har de inledningsvis haft en sista mänsklig auktorisering innan de AI-genererade meddelanden skickas ut, för att sedan ett par månader senare inse att 99,9% av meddelandena som genererats har accepterats. I detta fallet valde företaget att förlita sig fullständigt på AI:n och därmed lämnat den mänskliga kontrollen av programmet. Ett annat exempel på en AI-lösning som har en hög pålitlighetsgrad är AI inom marknadsföring som används för att optimera andelen besökare på en hemsida som utför en önskad uppgift, vilket Respondent 2 definierar som conversion rate. Respondent 2 menar att en AI har möjlighet att individanpassa reklam till besökare för att öka conversion rate på ett sätt som är nästintill omöjligt för människor att utföra. Ett annat exempel som Respondent 2 lyfter är redovisning och hur AI är på god väg att kunna ersätta de tusentals personer som jobbar med enkel redovisning där information förs från en plats till en annan. Å andra sidan finns där områden där AI har större svårighet att kunna operera självständigt utan mänsklig interaktion menar Respondent 2. Som exempel nämner Respondent 2 att när det gjorts försök till att med hjälp av AI bedöma huruvida ett läkemedel eller sjukvårdsutrustning skulle godkännas eller inte. Problematiken här menar han är att en AI alltid ändras efter att en analys utförts och den uppdateras till en ny version av sig själv utefter de lärdomar den drog från senaste analysen. I detta fallet blir då godkännandet av läkemedel inkonsekvent

18

och svårt att styra om det inte ges full insyn i hur AI:n väljer att godkänna eller avslå läkemedlet. Dock poängterar han att detta inte nödvändigtvis kommer vara ett olösligt problem och att det redan finns de som är på god väg att lyckas.

En annan utmaning AI står inför som berör många av dess potentiella användningsområden är det som kallas transparens. Transparens innebär kortfattat möjligheten att kunna granska analysprocessen som ledde fram till det beslut eller beslutsförslag som produceras av AI:n. Detta problem är något som även Respondent 2 lyfter i intervjun. Han tar upp ett exempel där AI används för godkännanden vid ansökningar om lån eller visum. Vanligtvis följer en förklaring kring varför man blev beviljad eller nekad ett visum eller lån men Respondent 2 poängterar att när algoritmerna är avancerade är det mycket svårt att programmet kan erbjuda full transparens i hur beslutet togs.

Vid användandet av facial recognition, alltså en AI som genom bildigenkänningsprogram lär sig att bättre identifiera personer, finns det etiska utmaningar som behöver beaktas. Respondent 2 beskriver i intervjun att de har tidigare jobbat med ett projekt där de undersökte möjligheten att använda sig av facial recognition i skolan för att markera närvaro i klassrummen. En etisk utmaning som diskuterades i detta projektet var bland annat att det finns risk för oönskade diskrimineringseffekter. Det finns en risk att om AI:n inte blir tillräckligt vältränad att identifiera individer med en stor bredd av utseendedrag så har den svårare att identifiera personer som har utseendedrag som skiljer sig från majoriteten. Detta innebär att algoritmen oavsiktligt blir diskriminerande mot de som inte har de karaktärsdragen som AI:n har tränats till att känna igen genom att inte identifiera dessa personer. Det är väldigt viktigt att det säkerställs att de algoritmer som används inte är oetiska på något vis, menar Respondent 2.

6 Analys

Från intervjuerna kunde vi identifiera vissa likheter och vissa olikheter. Många av åsikterna från intervjuerna delades, dock hade respondenterna olika bakgrunder och olika arbetspositioner, vilket kan påverka åsikterna om teknikerna. Vi ansåg att detta var en fördel för oss eftersom respondenternas svar kompletterade varandra. Båda respondenter ansåg att etik är en viktig faktor när AI ska användas och att etik är något som bör genomsyra hela utvecklingen av artificiell intelligens och Internet of Things. Respondent 1 nämnde risker med artificiell intelligens och Internet of Things och att dessa potentiellt kan leda till negativa händelser. Detta argument får medhåll från respondent 2 där han tar upp problematiken med självkörande bilar i framtiden och att stora flottor av dessa lätt kan bli utsatta för hackerattacker. Etikens väsentlighet inom AI nämns på olika sätt av respondenterna. Respondent 1 menar att ett etiskt problem med tekniken är hur etik och moral ska implementeras i en självgående AI. Hans argument förstärks av professorn Virginia Dignum (2018) som menar att en AI utan dessa faktorer kan orsaka en dyster framtid. Respondent 2 lyfter fram transparens som en problematisk faktor där han ansåg att det är väldigt svårt att kunna erbjuda full transparens i hur AI har fattat olika beslut.

Etiska risker som respondent 2 pekar på är AI:ns möjligheter att diskriminera. Han menar att problematiken i detta är hur AI:n tränas upp. Ifall AI:n inte tränas tillräckligt finns risken för oönskade diskrimineringseffekter.

Från det ovan nämnda stycket kan slutsatsen dras att respondenterna värderar etik högt. Båda respondenter angav liknande möjligheter med teknikerna där de ansåg att teknikerna kan vara lösningen till många samhällsproblem men att etiken bör vara ett ämne som löpande diskuteras.

Båda respondenter var väldigt positiva till de möjligheter som teknikerna kan bidra med. Respondent 2 var den som har mer erfarenhet och gav flera exempel på teknikerna i kombination, bland annat något han kallar för Robocup, vilket är en tävling där autonoma robothundar spelar fotboll med varandra. Han menade att den tekniken som används i det sammanhanget även kan tillämpas för search and rescue där man kan skicka ut ett team robotar som själva bestämmer hur de ska utföra en räddningsoperation i en katastrofsituation. Vidare menar han att användningsområdena för teknikerna är stora.